Amazon製の最新モデル「Amazon Nova」を試してみた

投稿日: 2024/12/12

はじめに

こんにちは。CTCの近藤です。

ChatGPTで有名なOpenAI社が月額200ドルで「o1 Pro mode」を利用できるChatGPTProを発表、Meta社がLlama3.1の性能を継承しながらもコストを大幅に削減した新モデル「Llama3.3 70B」を発表するなど、様々な企業が基盤モデル(FMs)に関する新サービスや新機能を多数発表する中、Amazonも先日(2024/12/3)開催されたAWS re:Invent 2024内のKeynoteにてAmazon独自開発のモデル「Amazon Nova」を発表しました。

https://aws.amazon.com/jp/about-aws/whats-new/2024/12/amazon-nova-foundation-models-bedrock/

そこで今回は発表されたばかりの「Amazon Nova」の説明と実際の利用方法についてご紹介したいと思います。

Amazon Novaとは

AWSでAPIを介して様々な基盤モデルを使用できるフルマネージドな生成AIサービスである「Amazon Bedrock」で新しく利用可能となったAmazonが開発したモデル群であり、「Micro」「Lite」「Pro」「Premier」「Canvas」「Reel」の6種類あります。(2024/12時点)

それぞれの主な特徴

テキスト生成モデル

Amazon Nova Micro:

最も低コストで低レイテンシー応答を提供するテキストのみのモデル。最大トークン数は128k。

Amazon Nova Lite:

画像、ビデオ、テキスト入力を高速で処理する低コストのマルチモーダルモデル。最大トークン数は300k。

Amazon Nova Pro:

Nova Liteよりも幅広いタスクに対応する精度、速度、コストのバランスがとれた、マルチモーダルモデル。最大トークン数は300k。

Amazon Nova Premier:

Novaシリーズで最も高性能なモデル。詳細については近日公開。

画像生成モデル

Amazon Nova Canvas:

プロンプトのテキストから画像を生成するモデル。テキスト入力で画像を編集できる他、配色やレイアウトの調整を行うことも可能。最大入力文字数は1024文字。

動画生成モデル

Amazon Nova Reel:

テキストと画像から動画を生成するモデル。テキストだけではなく画像からも動画を生成可能。最大入力文字数は512文字。また、近日中に2分間の動画生成にも対応する。(現在は6秒間)

利用手順(試してみた)

それでは実際に、「Amazon Nova」を試していきたいと思います。

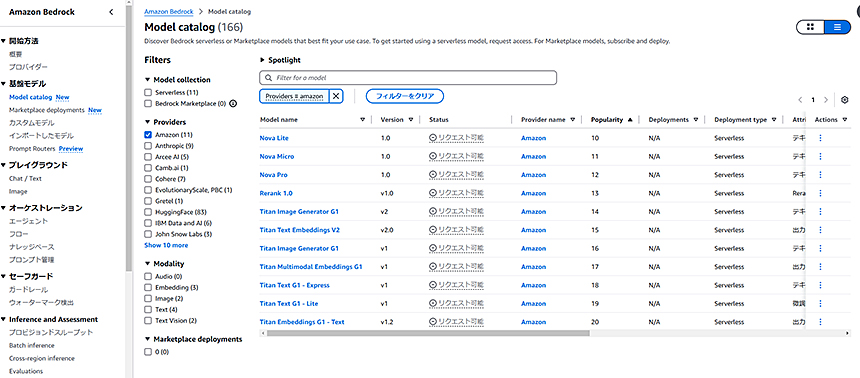

モデルの有効化

まず、Amazon Bedrockで新しいモデルを利用する際はモデル一覧から有効化のリクエストを行います。

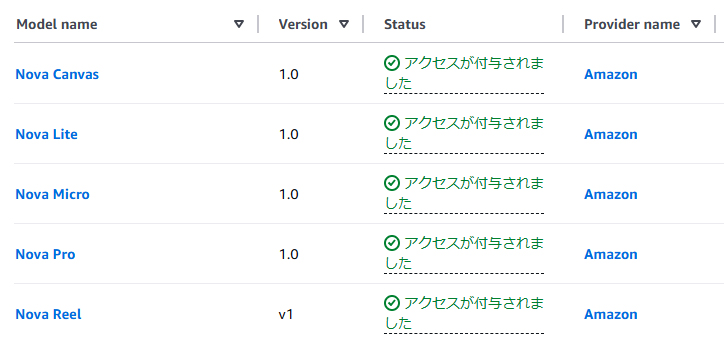

利用を行いたいモデルのStatusに表示されている「リクエスト可能」を選択し、「モデルアクセスをリクエスト」からアクセス申請を行うと、数秒~数分ほどでモデルへのアクセスが可能となり、「アクセスが付与されました」という表示となります。

この表示になればAmazon Bedrockから該当のモデルの利用が可能です。

プレイグラウンドでテキスト生成モデルを試してみる

モデルが利用可能となったら早速試してみましょう。

Amazon Bedrockで最も気軽にモデルを試す方法としてプレイグラウンドを利用する方法があります。

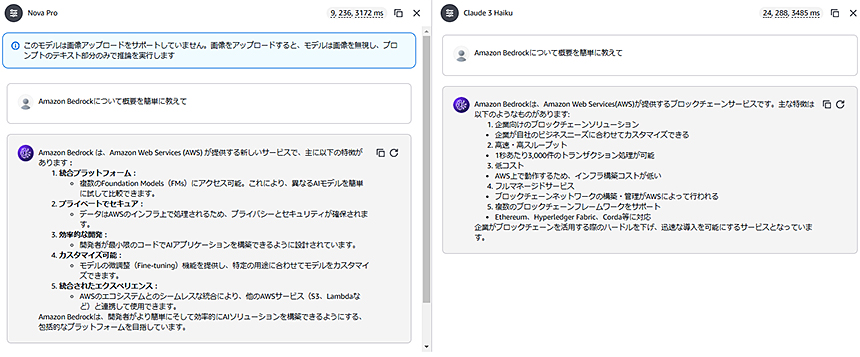

Amazon Bedrockのコンソール画面の左ペインにある[▼プレイグラウンド]-[Chat/Text]を選択し、Modeを「Chat」モデルの選択で試したいモデルを選択し、[適用]をクリックするだけで利用可能です。

試しに「Amazon Bedrockについて概要を簡単に教えて」と入力し、実行してみましょう。

今回は「Amazon Nova Pro」の他に比較としてAmazon Bedrockでも人気のモデルである「Claude 3 Haiku」と比較モードで比較してみます。

結果は上記の通りです。非常に精度の高い回答が返ってきている印象です。また、速度の速い「Claude3 Haiku」と比較してもより速い速度で回答が返ってきていることにも驚きです。

なお、「Amazon Nova Pro」と比較して「Amazon Nova Lite」ではレイテンシーは約500ms「Amazon Nova Micro」では約1000ms少ない結果となりました。

また補足事項として「Amazon Nova Micro」だけProやLiteと比較して、Output数が少ない結果となっています。

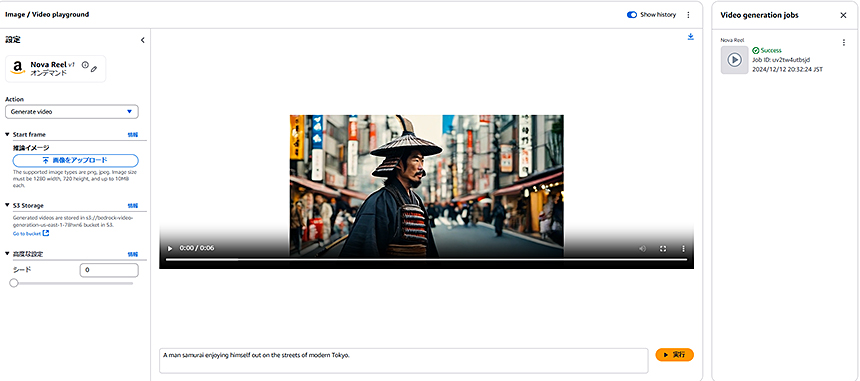

プレイグラウンドで画像/動画生成モデルを試してみる

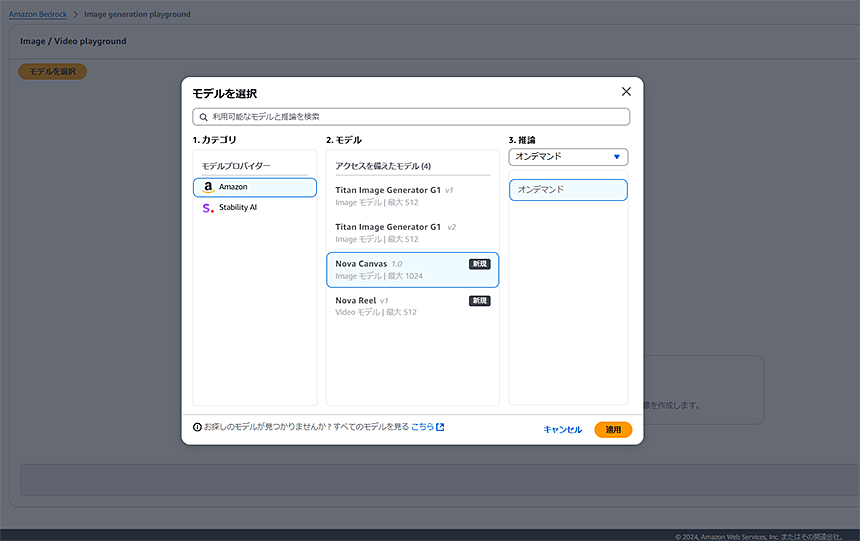

「Amazon Nova」にはテキスト生成モデル以外にも画像生成と動画生成のモデルも発表されているため、そちらも試してみましょう。なお、画像と動画についてもAmazon Bedrockのプレイグラウンドで試すことが可能です。

Amazon Bedrockのコンソール画面の左ペインにある[▼プレイグラウンド]-[Image/Video]を選択し、Modeを「image」モデルの選択で試したいモデルを選択し、[適用]をクリックするだけで利用可能です。

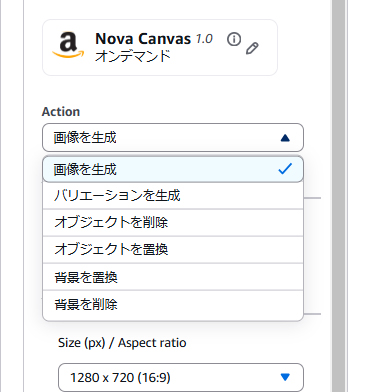

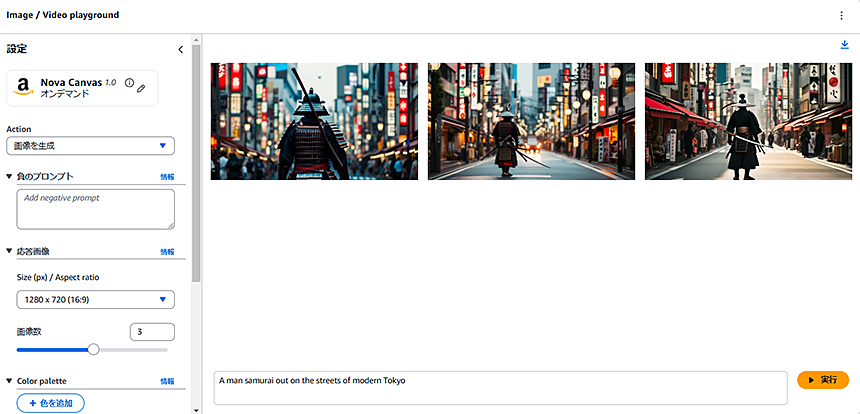

Image/Video Playgroundでは設定の[Action]にていくつかのアクションから選択可能です。

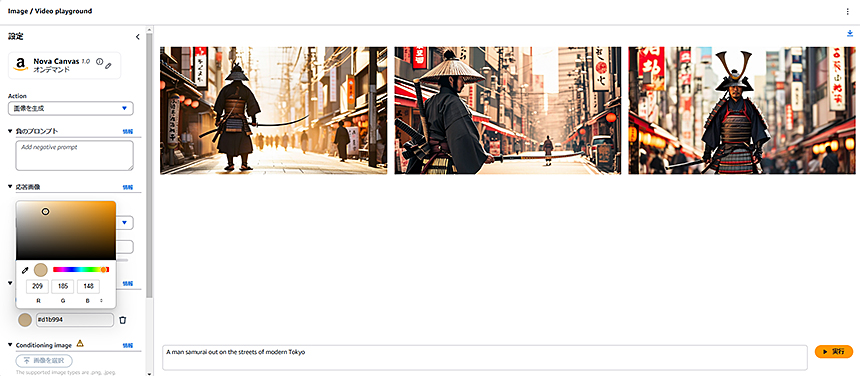

今回はアクションは[画像生成]で、試しに「A man samurai out on the streets of modern Tokyo」と入力し、実行してみましょう。

また、[設定]の[カラーパレッド]で色を指定するとカラーパレッドで指定した色も反映された画像を生成してくれます。

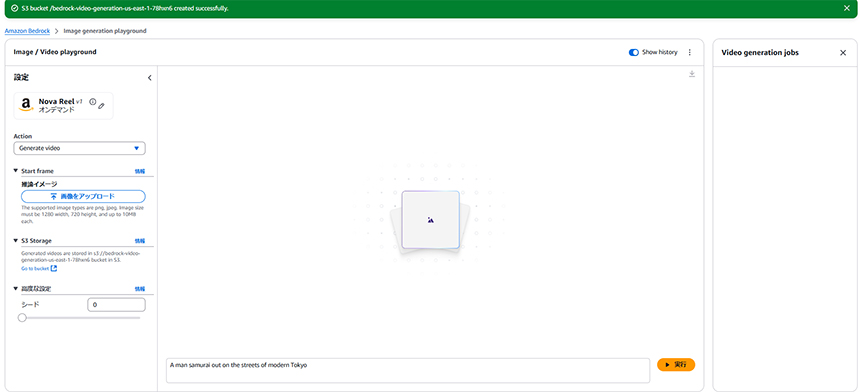

最後に動画生成も試してみましょう。

モデルの選択で[Video]に対応したモデルを選択し、[適用]をクリックするだけで利用可能です。

動画生成モデルを適用すると、生成された動画の保存先S3バケットが必要であるとのメッセージが表示され[確認]を選択すると自動的に動画の保存用バケットが生成されます。

「A man samurai enjoying himself out on the streets of modern Tokyo.」と入力し、実行してみましょう。

動画の生成には5分程度時間がかかります。

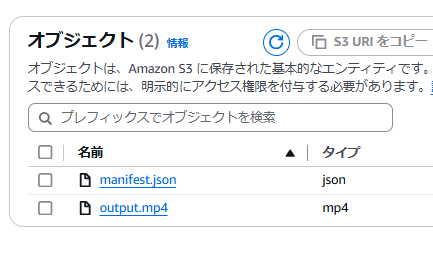

生成されると動画が再生可能となり、保存先のS3バケットにはmp4形式で動画が保存されています。

以下は実際に生成された動画ですが、プロンプト通り”楽しそう”にしていますでしょうか。

楽しそうかどうかはさておき、簡単にクオリティの高い動画を生成することができました。

APIでモデルを実行する

Converse APIリクエストを使用して、Amazon Novaモデルの呼び出し・実行をすることが可能です。

詳細についてはAWS公式の Amazon Nova ユーザーガイドにも掲載されています。

https://docs.aws.amazon.com/nova/latest/userguide/getting-started-api.html

Python SDK(Boto3)を使用してプレイグラウンドで試したプロンプトのサンプルを以下に記述します。

import boto3

import json

client = boto3.client(service_name="bedrock-runtime")

prompt = “Amazon Bedrockについて概要を簡単に教えて”

messages = [

{"role": "user", "content": [{"text": prompt}]},

]

model_response = client.converse(

modelId="amazon.nova-pro-v1:0",

messages=messages

)

print("\n[Full Response]")

print(json.dumps(model_response, indent=2))

print("\n[Response Content Text]")

print(model_response["output"]["message"]["content"][0]["text"])

まとめ

いかがでしょうか。

本記事では、AWS re:Invent 2024で発表されたばかりの「Amazon Nova」を試してみました。

テキスト生成の性能向上だけではなく、画像生成や動画生成などもより簡単に行えるようになったためAmazon Bedrockの活用の幅がより増えたと感じています。

特に「Amazon Nova Pro」は「Claude 3.5 Haiku」よりも低コストかつ応答速度も高速であり、今後Amazon Bedrockを用いた生成AIアプリケーション作成時の第一選択肢ともなりうるのではないかと思います。

今回紹介したモデルの他にも「Amazon Nova」シリーズでは「Speech-to-Speechモデル」や「Any-to-Any」モデルも近日登場すると発表されているため今後も期待して注目していきたい基盤シリーズです。

CTCは、AWSのビジネス利活用に向けて、お客様のステージに合わせた幅広い構築・運用支援サービスを提供しています。

経験豊富なエンジニアが、ワンストップかつ柔軟にご支援します。

ぜひ、お気軽にお問い合わせください。