AWSに構築した自社サービス環境改善を考える

~再エネ発電量予測サービス:発電量予測処理設計編~

投稿日: 2025/03/18

はじめに

こんにちは、滋野です。

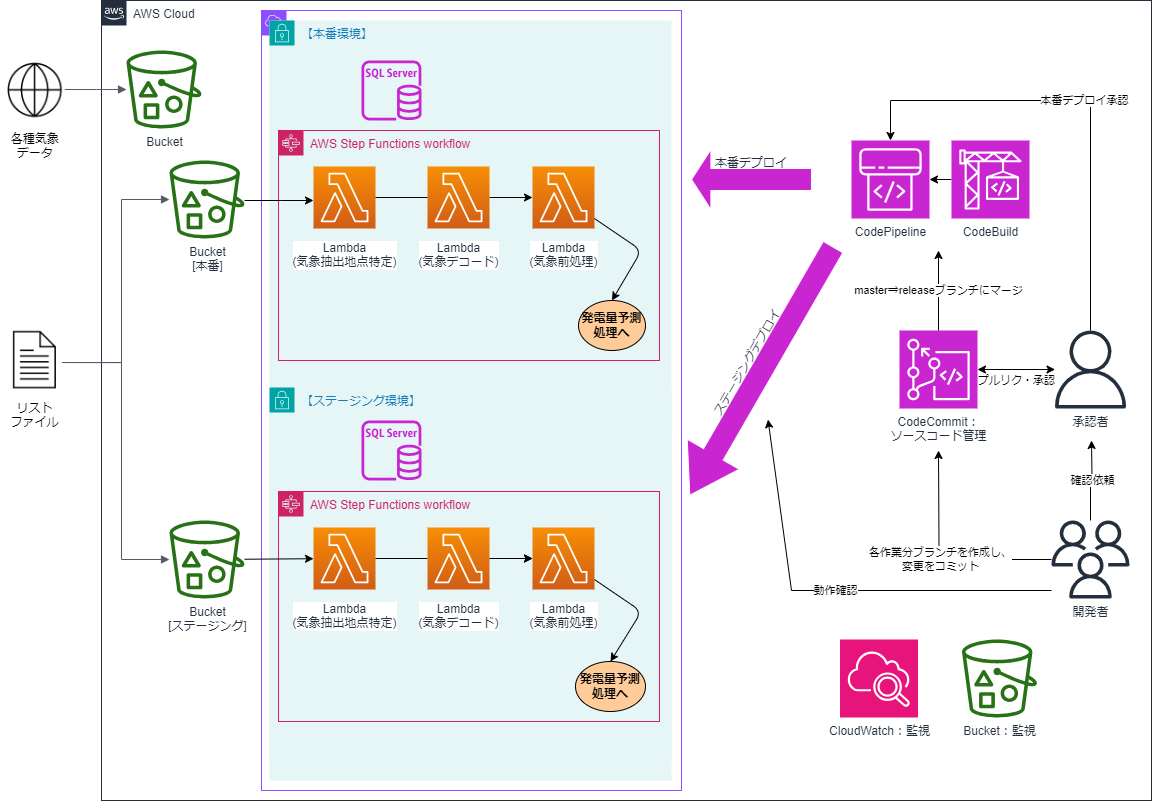

前回(AWSに構築した自社サービス環境改善を考える~再エネ発電量予測サービス:気象データ処理編~)は、再エネ発電量予測サービスに関する、気象データ処理の改善検討をご紹介しました。

今回は主に、発電量予測処理に対して、Amazon SageMakerを利用した環境改善を検討します。

前回のおさらい

前回は気象データの入力~気象データの前処理までの過程を実装しました。今回は前回実装した課題に対する対応策は踏襲しつつ、後続の発電量予測処理に関する設計検討を実施します。

発電量予測処理の概要

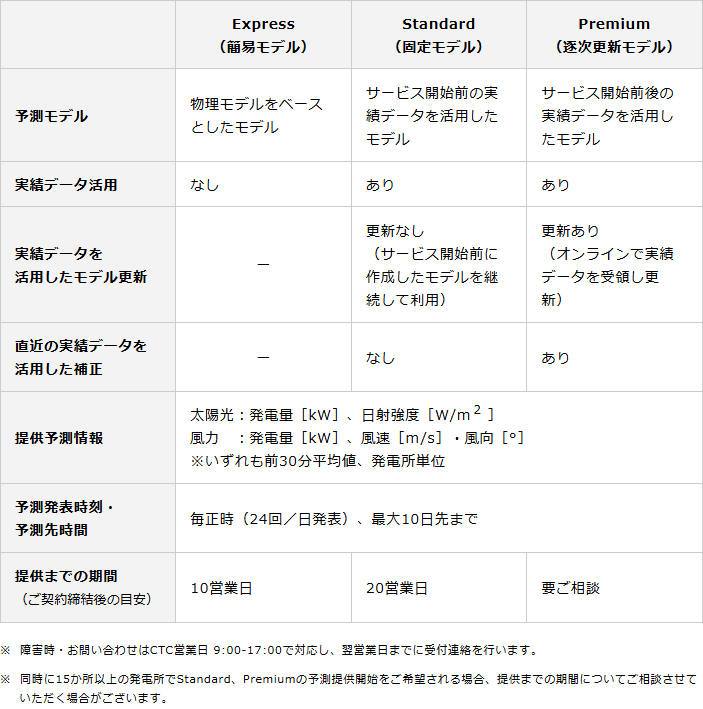

発電量予測処理では主な機能として、以下のような複数の発電量予測モデルを実装しています。それぞれの予測モデルは仕様や実行タイミングが異なるため、適切なデプロイ形式を検討する必要があります。

- 設備情報と気象予報データから発電量を予測するシンプルなモデル(Express)

- 機械学習を駆使して高精度な予測を目指すモデル(Standard)

- 直近の発電量実績データを活用して直近の発電傾向を反映し更に高精度な予測を目指すモデル(Premium)

発電量予測処理の流れ

発電量予測処理は一般的な機械学習モデルの開発・デプロイと同様に各処理を以下のような流れで実施しています。

発電量予測モデル構築処理

- 学習データ(気象予測データ・発電量実績データ等)の前処理

- 発電量予測モデル構築

- 発電量予測モデル評価

- パッケージング・デプロイ

発電量予測モデル適用処理

- 予測データ(気象予測データ等)の前処理

- 発電量予測モデル適用

- 予測結果データの整形

発電量予測モデル構築処理に関しては、データ量が大きいことに起因したモデル構築処理時間の増加、発電量予測モデル適用処理に関しては、実行頻度に応じたリソース管理やコスト管理に課題を抱えておりました。

対応方針

発電量予測モデル適用処理を中心とした比較的、処理時間を要さない処理はLambdaを中心としたコンピューティングサービスで、発電量予測モデル構築処理を中心とした機械学習関連処理は、Amazon SageMaker AI※を用いて、実装します。

※2024年12月より従来Amazon SageMakerと呼ばれたサービスはAmazon SageMaker AI に名称変更されました。(次世代Amazon SageMakerに関しては以下をご参照ください!)

https://aws.amazon.com/jp/blogs/news/introducing-the-next-generation-of-amazon-sagemaker-the-center-for-all-your-data-analytics-and-ai/

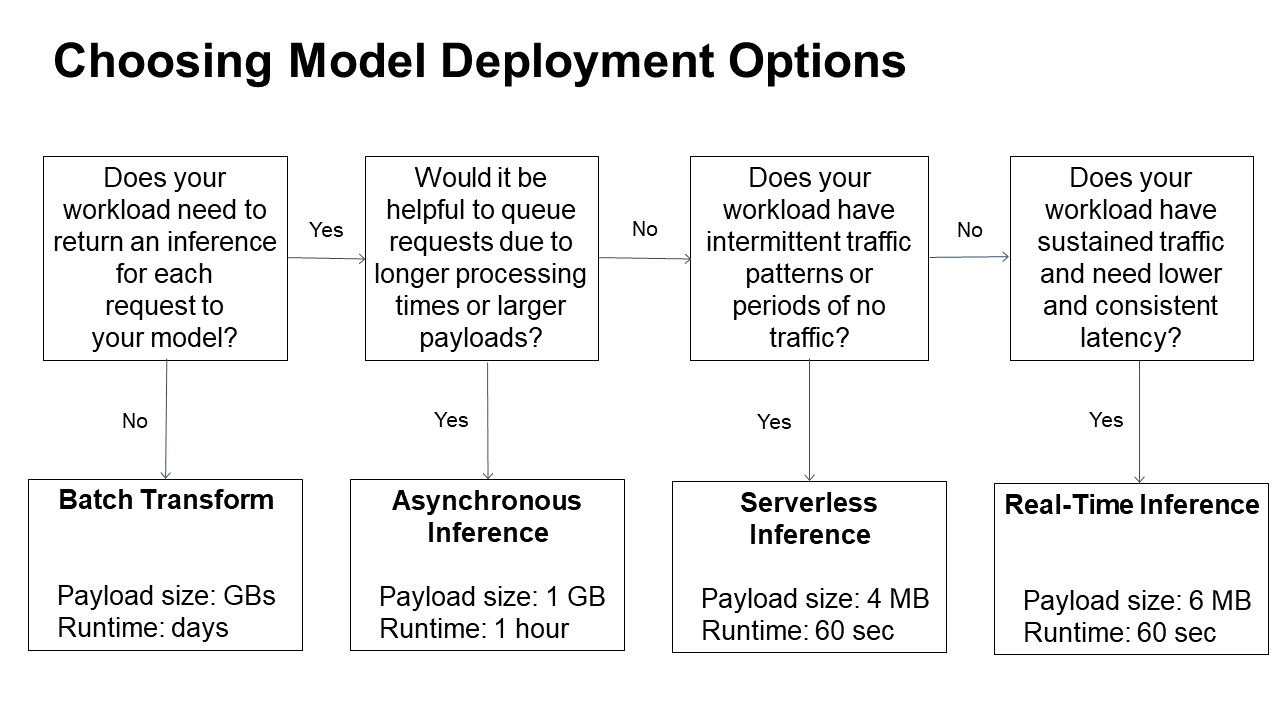

Amazon SageMaker AIを用いた機械学習モデルの設計にあたり、検討する一つの要素として、デプロイオプションがあります。

以下デプロイオプションの内、本サービスにはどれが適切か検討しました。

| リアルタイム 推論 |

サーバレス推論 | 非同期推論 | バッチ変換 | |

|---|---|---|---|---|

| 実行モード | 同期 | 同期 | ⾮同期 | ⾮同期 |

| レイテンシ | 秒以下 | 秒以下 | 数秒〜数分 | 不定 |

| 呼び出しモード | 連続ストリーム /APIコール |

連続ストリーム /APIコール |

イベント | イベント/ スケジュール |

| データサイズ | 6MB | 4MB | 1GB | 1GB以上 |

| 概要 | 低レイテンシや高スループットが要求されるオンライン推論 | 断続的またはまれなトラフィックパターンを伴う処理 | リクエストをキューに入れる必要がある推論、および大きなペイロードサイズや長時間の処理を要する推論に最適 | 大量のデータが事前に利用可能で、永続的なエンドポイントが必要ない場合のオフライン処理に適している |

https://docs.aws.amazon.com/ja_jp/sagemaker/latest/dg/how-it-works-deployment.html

https://pages.awscloud.com/rs/112-TZM-766/images/AWS-Black-Belt_2022_Amazon-SageMaker-Inference-Part-3_1014_v1.pdf

https://docs.aws.amazon.com/ja_jp/sagemaker/latest/dg/deploy-model-options.html

結果とまとめ

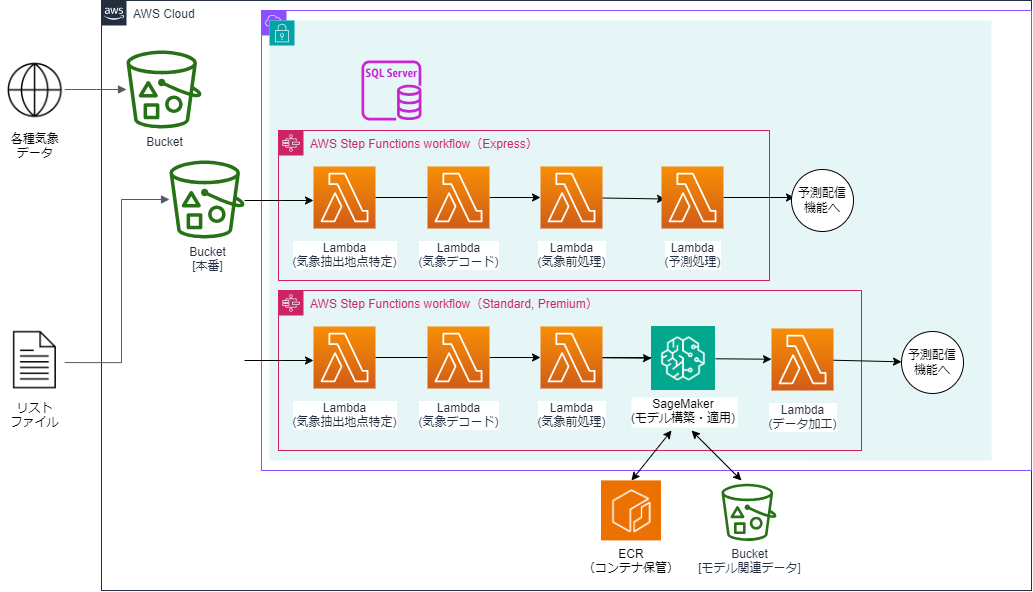

結果として以下のような構成を検討しています。

◇Express(簡易モデル)

発電量予測モデル構築・適用処理:Lambdaを中心としたリソースで構成

◇Standard(固定モデル)、Premium(逐次更新モデル)

発電量予測モデル構築処理:SageMakerバッチ変換

発電量予測モデル適用処理:Lambdaを中心としたリソースで構成(SageMakerエンドポイントを呼び出し)

SageMaker AIのデプロイオプションは、主にデータサイズと実行時間の関係からバッチ変換を検討しています。コスト面(推論した分だけの課金)や、スケーリング等の面でもメリットが大きいと考えています。

また、つい先日リリース(GA:一般提供開始)されたAmazon SageMaker Unified Studioを用いた統合的な管理も今後検討したいと考えています。

https://aws.amazon.com/jp/sagemaker/unified-studio/

さいごに

今回は、サービス改善に向けて発電量予測処理の設計検討を実施しました。これらの内容が、今後同様のシステムを実装する際のヒントになれば幸いです。

弊社はAWS、再エネ関連データともに扱いに長けたエンジニアが多数所属しております。

AWSでの再エネデータ利活用に関するご相談は、お気軽にCTCまでお寄せください!

CTCは、AWSのビジネス利活用に向けて、お客様のステージに合わせた幅広い構築・運用支援サービスを提供しています。

経験豊富なエンジニアが、ワンストップかつ柔軟にご支援します。

ぜひ、お気軽にお問い合わせください。