[ALX202] Advances in machine learning that make Alexa sound human-like Instance(AI/ML)

投稿日: 2022/12/09

今回のセッションでは、Amazon Alexaのレスポンスを楽しく、状況に応じた情報を提供しながら、簡潔かつ正確にするテキスト音声変換技術について学びました。

セッションアジェンダは次のとおりです。

【紹介】

- なぜ音声AIは人間のように聞こえるのですか?

- 人間の良い会話はどのように聞こえますか?

[テキスト音声変換(TTS)の技術的背景]

- Alexaスタック

- MLアーキテクチャの概要

[人間よりも人間らしい言葉を生成するためのML]

- 文脈化法

- 適切な言葉

- パーソナライズされたスピーチ

記録によると、2022年にはアメリカ人口の約37%、つまり1億2340万人が音声秘書を使うだろうという。

また、音声AI機器は2024年までの世界人口(>80億人)を超えると予想しています。

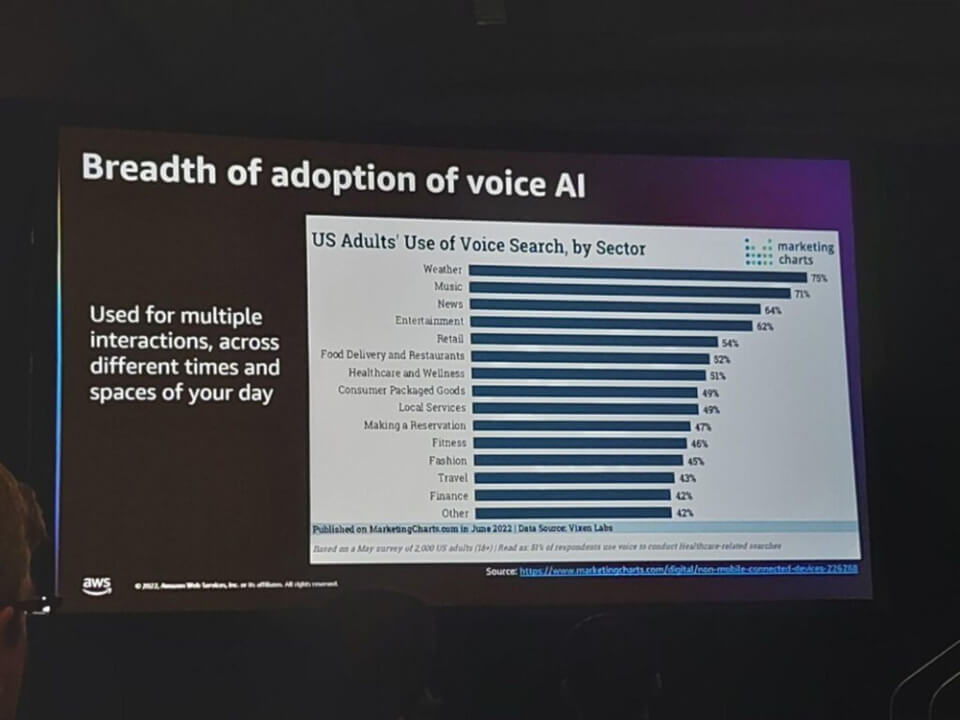

音声AIは広く採用され使用されています。次の表に示すように、さまざまな時間と空間でさまざまな分野で対話して使用されます。

それでは、AI音声はどのように人のように聞こえるのでしょうか?

- 人間化されたAI音声により、顧客満足度と使用率が向上します。

- 音声秘書がより強力になり、使いやすく、文脈をはるかによく理解できるようになるにつれて、より多くの人々が音声検索と仮想秘書に頼って日々の仕事を助けます。

- 声の現実性と認識された人間性が増加するにつれて、社会的アプリケーション(例えば、世話、仲間関係)への受け入れも増加するようです。

それでは、Alexaはどうすればいいですか?

- 私たちのビジョンは、アレクサが顧客に欠かせない秘書、信頼できるアドバイス、面白い、思いやりのある仲間になることです。

- このビジョンを実現するには、Alexaは、認識、学習、推論、相互作用など、最高の人間の知能と組み合わせて最高の機械知能を提供する必要があります。

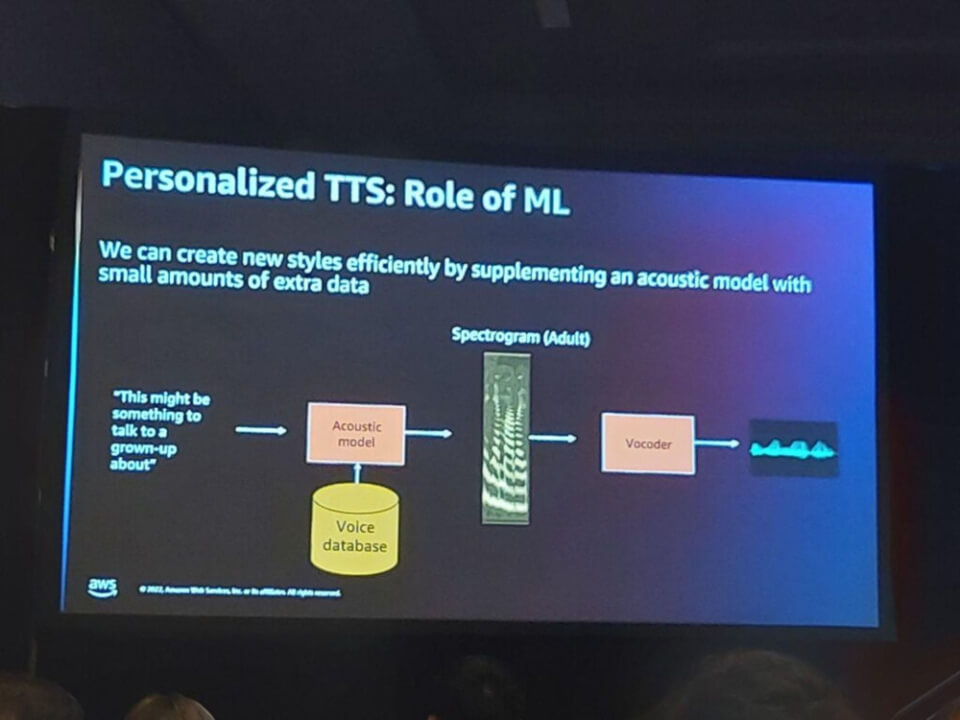

少量の追加データでサウンドモデルを補完することで、新しいスタイルのサウンドを効率的に作成できます。

サウンドモデルに新しく追加された情報と既存の蓄積された音声DBを提供し、Spectrogramを介して入力された音声の周波数、振幅、時間で分析して画像に変換します。

その後、Vocoderを使用してSpectrogramを実際の音声であるWaveformに変換します。

パーソナライズされた話法の利点は次のとおりです。

- 信頼、顧客満足、参加

- Alexaが先生の声を使うときにAmazon Mathの数学問題を解くとき、子供たちはもっと学ぶことができます

- アンケート調査によると、両親も声を好む

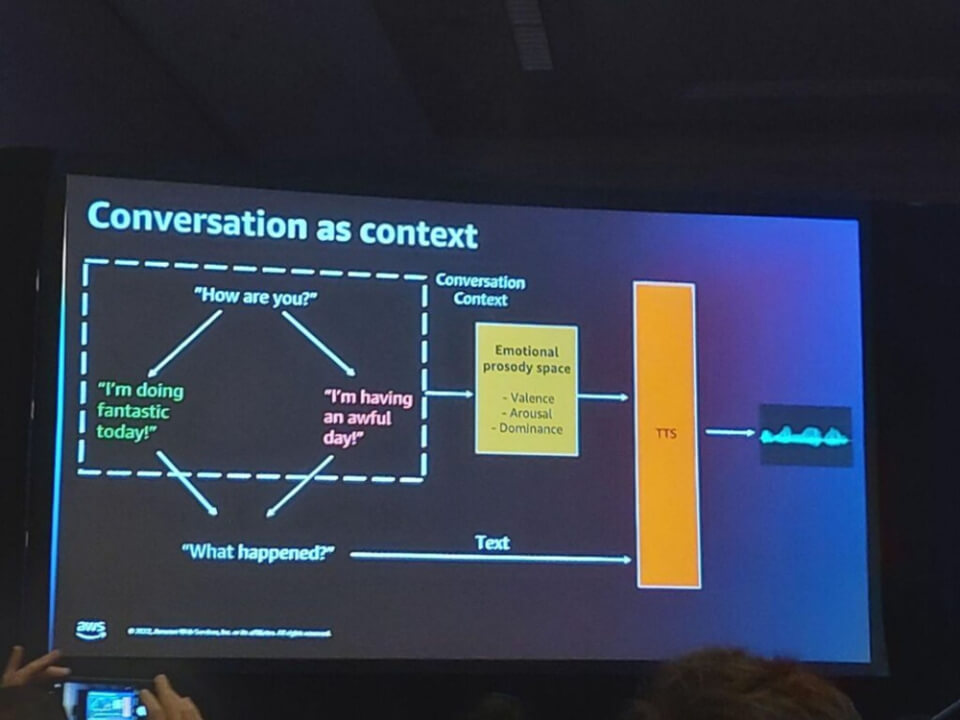

コンテキストとしての会話の例です。

Alexaが「How are you?」と質問したとき、「I'm doing fantastic today」のような肯定的な答えをする場合、明るいトーンの「What happened?」という質問につながり、「How are you?」と質問したとき「I'm having an awful day!」のような否定的な答えをすると、やや暗いトーンの「What happened?」という質問につながります。

このように、Alexaはユーザーの答えを介して感情を分析し、同じ答えであっても感情に従って個人化された音声を出力します。

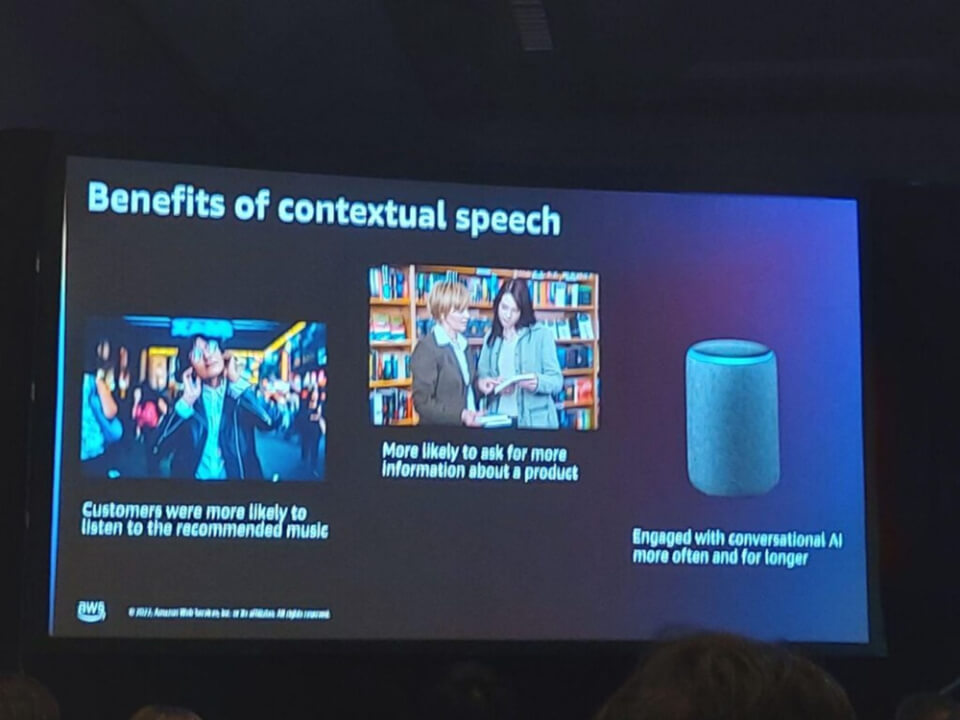

状況に合った話法の利点は次のとおりです。

- 顧客がおすすめの音楽を聴く可能性が高い

- 製品に関する詳細情報をリクエストする可能性が高い

- インタラクティブなAIにもっと頻繁に、より長く参加

関係のある話法

- 私たちはAlexaと話すことが友人や家族と話すようになりたいです。

- Alexaのグローバル顧客層に合わせて様々な声が必要です。

- 改善には、音声の多様性と言語とアクセントの多様性があります。

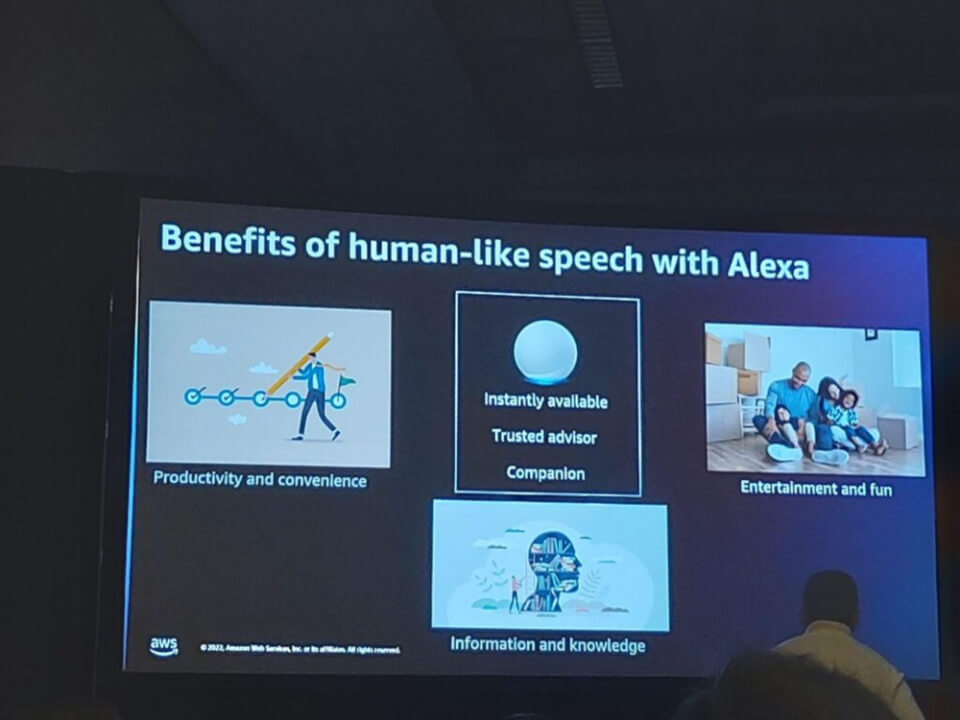

Alexaとの人間らしい会話の利点は次のとおりです。

- 生産性と利便性

- 情報と知識

- 娯楽と喜び

Amazonが開発したAI音声プラットフォームであるAlexaの特徴と機能を学ぶことができ、特にAI技術をどのように反映し、それによる結果はどうなったのか直接音声で聞くことができ、有益で興味深かったです。