CUVIC GPU Zero(キュービック ジーピーユー ゼロ)は、AIエージェント開発機能をワンパッケージで提供し機密データを安全に活用できる生成AI基盤サービスです。

CUVIC GPU Zero の特長

フルマネージド

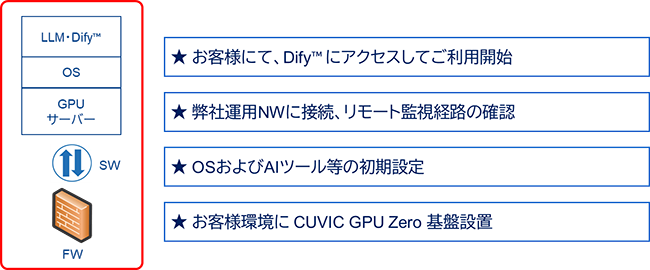

① CUVIC GPU Zero 導入

以下の作業を弊社にてワンストップで対応いたします。

- 生成AI基盤のお客様拠点への設置作業

- 機器構築作業を含む導入作業

- 導入後の保守、運用

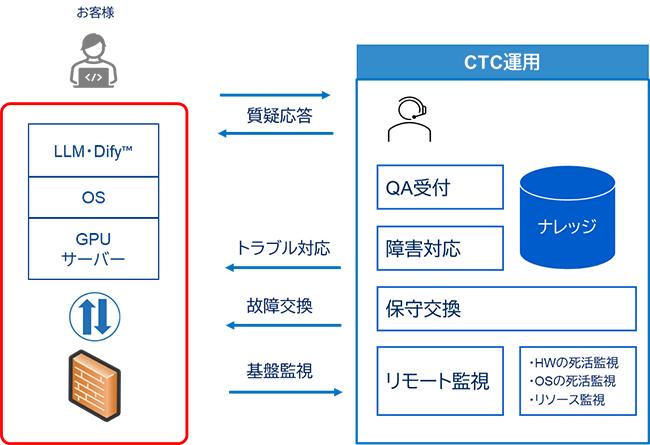

② CUVIC GPU Zero 保守

安定した基盤をご提供すると共に、障害/保守対応やQA対応窓口をご提供します。

③ CUVIC GPU Zero 運用

ご提供するGPU基盤のハードウェア運用やOSの脆弱性対応を行います。

また、年間2回GPU基盤に増設されているLLMモデルの更新情報を連携し、お客様の要望に応じて、更新作業を実施いたします。

| No | 対応項目 | 対応内容 |

|---|---|---|

| 1 | ハードウェアのファームウェア更新 |

|

| 2 | オペレーティングシステムの脆弱性対応 |

|

| 3 | LLMモデルの更新 |

|

| 4 | 運用ネットワーク機器のオペレーティングシステム更新 |

|

導入後、すぐに利用可能

- GPUサーバーから開発プラットフォーム(Dify™)までをパッケージングした製品を提供いたしますので、導入後、すぐにご利用可能です。

- 推論用途および社内の特定業務に特化した最適な環境をご提供します。

| 導入規模 |

|

|---|---|

| 導入環境 |

|

信頼性の高いインフラ基盤をご提供

- 24時間/365日稼働を想定した高信頼GPU

NVIDIA RTX PRO 6000 (96GB GPUメモリ)を搭載した高信頼のGPU基盤をご提供します。 - 同時100アクセスに対応可能なハードウェア構成

同時10リクエストを実施時に、20トークン/秒以上のスループットで処理できる

※ 実利用条件が異なるため、あらゆる条件下でも同時アクセスに耐えられることを保証するものではありません。 - 多重アクセスにも強いソフトウェア構成

ハードウェアリソースを効率的に利用できるように、

無駄な処理待ち時間を最小化し、遂次処理する仕組みを組込んだ構成としております。

厳選した生成AIを選定

- 業務利用に適した言語モデルをプリインストールしております。

- 汎用的なLLM(大規模言語モデル)に加え、マルチモーダル対応のMLLM、図表やグラフ処理に強いVLMなどを搭載し、ご利用用途に合わせてモデルを切り替えながらLLMをご利用可能です。

- RAG(検索拡張生成)の精度に関連する「エンベディングモデル」や文書解析ツールも搭載しており、複雑な表形式が含まれるPDF資料なども、高精度で解析、分析されることが可能です。

|

生成AIモデル |

LLM |

gpt-oss-20b |

オープンソースで提供される 20B パラメータの汎用LLM。 |

|

MLLM |

Gemma3-12B-it-GPTQ |

Gemma3 の軽量版AIモデル。省メモリで高速動作を実現し、社内ツールへのAI組み込みや文章処理に利用可能 |

|

|

Gemma3-27B-it-GPTQ |

12B よりも高精度な理解力を持ち、情報検索・文書生成・文章要約など精度重視の業務に適しているモデル |

||

|

VLM |

Karakuri-VL-32B-Instruct |

日本語を含む多言語の画像内テキストを理解することや図表の読解に強みがあるモデル |

|

|

エンベディング |

Ruri-v3-310m |

軽量で高速に動作し、社内ツールの簡単な自動化やチャットボットに利用可能なモデル |

|

|

multilingual-e5-large |

多言語処理に対応可能。文章の意味を理解して必要な情報を探し出すこと(意味検索)を得意とし、資料検索や問い合わせ対応などに適しているモデル |

||

搭載LLMは、購入時期によって変わる可能性がございます。最新の搭載モデルはCUVIC GPU Zeroサービス担当までお問い合わせください。